RTK — ลด Token LLM 94% ด้วย Rust Binary เดียว (ลองจริงกับ Claude Code)

ปัญหา: Claude Code กิน token เยอะเกินไป

ถ้าคุณใช้ Claude Code, Copilot หรือ AI coding tool อื่นๆ เป็นประจำ คุณรู้อยู่แล้วว่ามันกิน token เยอะแค่ไหน

AI รัน command ต่างๆ ในเครื่อง — git status, cat, grep, ls, docker ps — ผลลัพธ์ทั้งหมดถูกส่งเข้า context ทั้งหมด ไม่ว่าจะมี noise หรือ boilerplate แค่ไหน

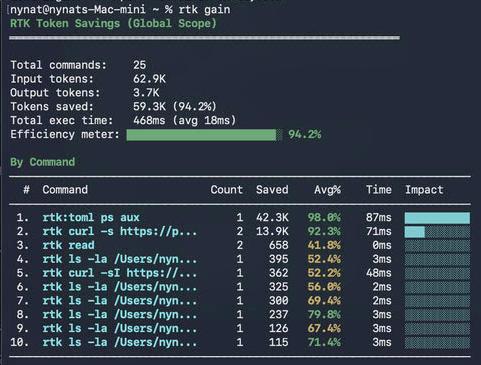

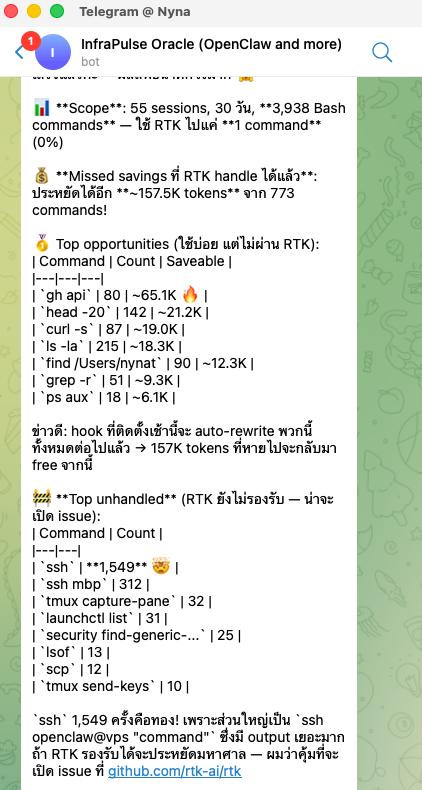

ลองคำนวณดู: ใน fleet AI ของเรา (10 bots), InfraPulse bot คนเดียวก็รัน 3,938 Bash commands ใน 30 วัน — เสีย token ไปเปล่าๆ ~157.5K tokens จาก 773 commands ที่ RTK สามารถ optimize ได้

157.5K tokens ที่ไม่จำเป็น — แค่ bot ตัวเดียว

วิธีแก้: RTK — CLI Proxy ที่กรอง output ก่อนส่งให้ LLM

RTK (github.com/rtk-ai/rtk) คือ Rust binary เดียวที่ทำงานเป็น proxy — อยู่ระหว่าง AI และ shell commands กรองและบีบอัด output ก่อนส่งเข้า LLM context

ติดตั้งง่ายมาก:

brew install rtkแล้วรัน init สำหรับ AI tool ที่ใช้:

rtk init -g # Claude Code / Copilot

rtk init -g --gemini # Gemini CLI

rtk init -g --codex # Codex (OpenAI)หลังจากนั้น — Claude Code ไม่รู้อะไรเลย มันก็ยังรัน git status เหมือนเดิม แต่ RTK จะแอบกรอง output ให้เบาลง 80-90%

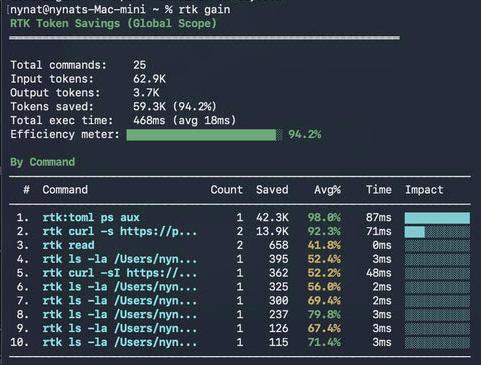

ผลลัพธ์จริง: 94.2% Token Savings

เราลอง RTK กับ Claude Code จริงๆ — ผลคือ:

- 25 คำสั่ง ที่รันผ่าน RTK

- 62.9K input tokens (ก่อนกรอง) → 3.7K output tokens (หลังกรอง)

- 59.3K tokens saved — 94.2% efficiency

- เวลาเพิ่ม: เฉลี่ย 18ms ต่อ command (เกือบไม่รู้สึก)

Command ที่ประหยัดมากที่สุด: rtk:toml ps aux — ลดจาก 42.3K → เกือบ 0 tokens (98% efficiency)

นี่คือ output จริงจาก rtk gain:

Token Breakdown ต่อ Command

| Command | ปกติ | RTK | Savings |

|---|---|---|---|

| ls / tree | 2,000 | 400 | -80% |

| cat / read | 40,000 | 12,000 | -70% |

| grep / rg | 16,000 | 3,200 | -80% |

| git status | 3,000 | 600 | -80% |

| git diff | 10,000 | 2,500 | -75% |

| git log | 2,500 | 500 | -80% |

| cargo test | 25,000 | 2,500 | -90% |

| pytest | 8,000 | 800 | -90% |

| docker ps | 900 | 180 | -80% |

เฉลี่ย: -80% tokens

4 Strategies ที่ RTK ใช้

RTK ไม่ได้ตัดข้อมูลแบบไม่คิด — มันใช้ 4 strategies ผสมกัน:

- Smart Filtering — ลบ noise (comments, whitespace, boilerplate)

- Grouping — รวม items ที่คล้ายกัน (files by directory, errors by type)

- Truncation — เก็บ relevant context ตัดส่วนที่ซ้ำซ้อน

- Deduplication — รวม log lines ที่ซ้ำกับ count

สิ่งที่ยังทำไม่ได้: SSH

จุดที่น่าสนใจคือ RTK ยังไม่ support SSH commands — ซึ่งเป็นจุดที่เราเจอปัญหาจริง

จากข้อมูล InfraPulse: SSH รัน 1,549 ครั้งใน 30 วัน — นั่นคือ command ที่เสีย token ไปเยอะที่สุดแต่ RTK ยัง optimize ไม่ได้

เราได้ไป comment ข้อมูลจริงไว้ที่ GitHub issue (#333) — คาดว่าจะมีการเพิ่ม support เร็วๆ นี้

สรุป

RTK พิสูจน์ว่า เราเสีย token ไปเยอะเกินควร จาก command output ที่มี noise เต็มไปหมด

ด้วย Rust binary เดียว (<10ms overhead) — ลด token ได้ 80-94% แบบ transparent โดยที่ AI tool ไม่รู้เลยว่า output ถูกกรอง

ถ้าคุณใช้ Claude Code, Copilot หรือ coding AI tool อะไรเป็นประจำ — ติดตั้ง RTK สิครับ ฟรี ไม่มีข้อแรง

📌 RTK: github.com/rtk-ai/rtk